Một bản cập nhật sai lầm lúc 4 giờ sáng đã khiến Anthropic - startup AI tỷ đô luôn tự định vị mình là "phòng thí nghiệm AI ưu tiên an toàn" - phơi bày toàn bộ mã nguồn của Claude Code. Đây là một sự cố bảo mật chấn động, phơi bày không chỉ hàng trăm nghìn dòng code mà còn cả lộ trình công nghệ trong tương lai của hãng.

Sự cố rò rỉ mã nguồn "ngớ ngẩn" nhất lịch sử Anthropic

Sự việc bắt đầu vào lúc 4 giờ sáng khi đội ngũ kỹ sư của Anthropic đẩy một bản cập nhật thường lệ cho Claude Code - công cụ lập trình AI đang cực kỳ phổ biến của hãng. Thật không may, một file debugging (gỡ lỗi) nội bộ đã vô tình được đóng gói chung và tải thẳng lên registry công khai.

Lập tức, nhà nghiên cứu Chaofan Shou đã phát hiện ra file này. Nó trỏ trực tiếp đến một kho lưu trữ nén trên hệ thống cloud của chính Anthropic. Kết quả? Gần 2.000 file với 512.000 dòng code đã bị tải xuống. Mặc dù phát ngôn viên của Anthropic nhanh chóng xoa dịu dư luận rằng đây chỉ là "lỗi do con người" và không có dữ liệu khách hàng nào bị lộ, nhưng trong giới công nghệ, việc mã nguồn cốt lõi bị phơi bày là một thảm họa không thể chối cãi.

Một coder đã viết lại toàn bộ mã nguồn này bằng Python và đẩy lên GitHub

Những tính năng "bí mật" và lộ trình tương lai bị phơi bày

Việc mổ xẻ mã nguồn đã vô tình cấp cho các đối thủ cạnh tranh một tấm vé "VIP" để xem trước lộ trình phát triển của Anthropic. Hàng tá feature flags (cờ tính năng) cho thấy những vũ khí bí mật đã hoàn thiện nhưng chưa được phát hành, bao gồm:

- Khả năng tự đánh giá (History Review): Claude có thể xem lại những thao tác trong phiên làm việc trước để tự rút kinh nghiệm và cải tiến trong tương lai.

- Trợ lý thường trực (Persistent Assistant): Một tính năng chạy ngầm cho phép Claude tiếp tục làm việc, suy nghĩ và hoàn thành tác vụ ngay cả khi người dùng không tương tác.

- Điều khiển từ xa: Khả năng ra lệnh cho Claude từ điện thoại hoặc một trình duyệt khác.

Không chỉ dừng lại ở tính năng, mã nguồn còn tiết lộ Anthropic đang hướng tới các hệ thống đa tác nhân (multi-agent) và bộ nhớ sâu hơn. Gần đây, những thông tin rò rỉ về mô hình Claude Mythos và các tin tức AI mới nhất đã liên tục xuất hiện. Đặc biệt, theo nhà nghiên cứu bảo mật Roy Paz, mã nguồn đã xác nhận sự tồn tại của mô hình nội bộ mang tên Capybara và Mythos - những hệ thống được cho là mạnh mẽ nhất trên thị trường nhưng cũng tiềm ẩn rủi ro an ninh mạng chưa từng có.

Cú "Twist" ngoạn mục: Lách luật DMCA với Python và Rust

Phần kịch tính nhất của câu chuyện không nằm ở lỗi lầm của Anthropic, mà là cách cộng đồng mã nguồn mở phản ứng.

Sigrid Jin, một lập trình viên người Hàn Quốc (và cũng là một trong những người dùng Claude Code tích cực nhất thế giới với 25 tỷ token/năm), đã tải mã nguồn này về. Lo sợ bị Anthropic kiện vì vi phạm bản quyền trên máy cá nhân, Jin đã có một pha xử lý "đi vào lòng người": Thức trắng đêm để viết lại toàn bộ mã nguồn bằng Python từ đầu.

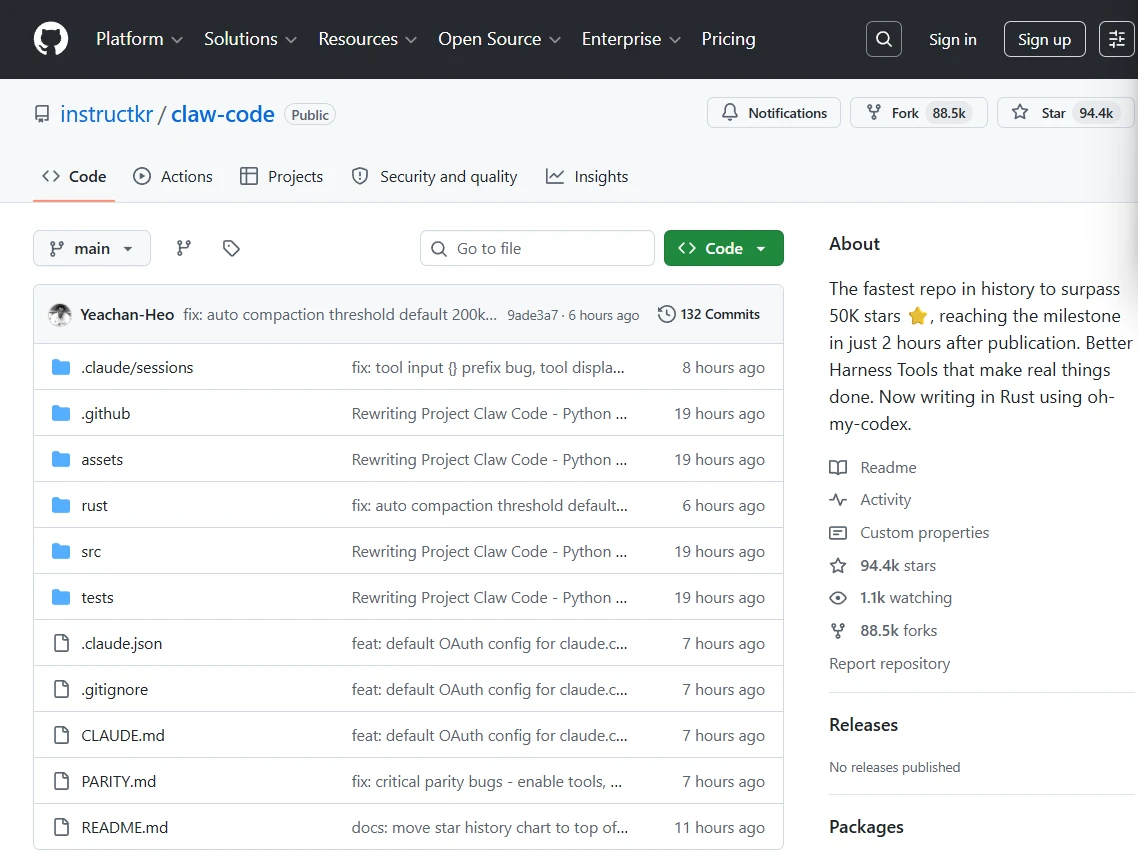

Theo luật bản quyền, một bản viết lại bằng ngôn ngữ khác được xem là một "tác phẩm phái sinh sáng tạo mới". Do đó, đạo luật bản quyền DMCA không thể can thiệp để gỡ bỏ nó. Dự án mang tên claw-code ngay lập tức được đẩy lên GitHub và đạt 30.000 stars với tốc độ kỷ lục. Chưa dừng lại ở đó, Jin tiếp tục viết thêm một phiên bản bằng Rust. Hiện tại, dự án đã có hơn 52.000 stars và 56.000 lượt forks.

Thậm chí, cộng đồng Web3 đã đưa mã nguồn này lên các nền tảng phi tập trung với tuyên bố đanh thép: "Sẽ không bao giờ bị gỡ xuống". Mã nguồn giờ đây đã trở thành bất tử.

Bài học đắt giá cho ngành công nghiệp AI

Sự rò rỉ này sẽ không khiến Anthropic phá sản, nhưng nó chẳng khác nào một khóa học thạc sĩ miễn phí cho các đối thủ cạnh tranh (như OpenAI, Google) về cách xây dựng một AI coding agent cấp độ doanh nghiệp.

Điều trớ trêu nhất? Anthropic từng tự hào khoe về hệ thống Undercover Mode - một cơ chế được thiết kế đặc biệt để ngăn AI rò rỉ bí mật công ty. Vậy mà, chính con người lại là mắt xích yếu nhất tự phơi bày toàn bộ bí mật đó. Đây là sự cố bảo mật lớn thứ hai của hãng chỉ trong vòng một tuần, gióng lên hồi chuông cảnh báo về quy trình vận hành an ninh tại các tập đoàn AI hàng đầu thế giới.